Loading...

About this Episode

Seventy3:借助NotebookLM的能力进行论文解读,专注人工智能、大模型、机器人算法、crypto方向,让大家跟着AI一起进步。

如果你想要解读自己的论文,获得更多曝光度。请联系小助手微信:seventy3_podcast 加群。

合作邮箱:zhiwudazhanjiangshi#gmail.com

今天的主题是:

Self-Improving Pretraining: using post-trained models to pretrain better models

Summary

确保大语言模型生成内容的安全性、事实性及整体质量是一项严峻挑战,尤其是在这些模型日益广泛应用于现实场景的背景下。目前解决这些问题的主流方法是收集昂贵且精心策划的数据集,并进行多阶段的微调与对齐。然而,即便采用如此复杂的流程,也无法保证能彻底纠正模型在预训练阶段习得的模式。

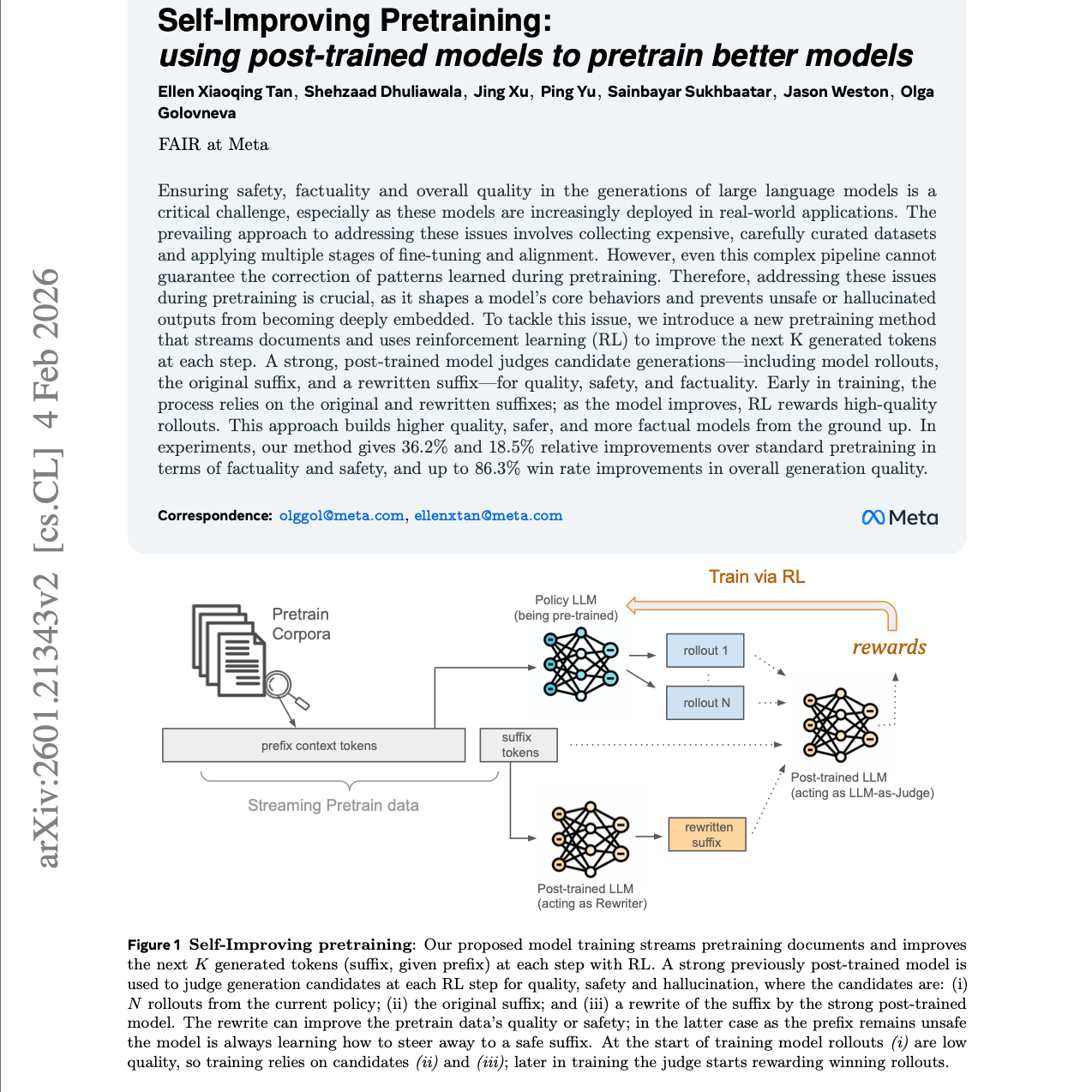

因此,在预训练阶段解决这些问题至关重要,因为预训练塑造了模型的核心行为,并能从源头上防止不安全或幻觉输出的根深蒂固。为了应对这一挑战,我们提出了一种全新的预训练方法:通过流式处理文档,并利用强化学习(RL)在每一步优化后续生成的 K 个 Token。

该方法引入一个强大的后验模型,对包括模型预测序列(Rollouts)、原始后缀及重写后缀在内的候选生成内容进行评分,评估其质量、安全性与事实性。在训练初期,该过程依赖于原始和重写的后缀;随着模型能力的提升,强化学习将奖励高质量的模型预测序列。这种方法从底层构建了更高质量、更安全且更具事实性的模型。

实验表明,与标准预训练相比,我们的方法在事实性和安全性方面分别带来了 36.2% 和 18.5% 的相对提升,在整体生成质量的胜率上最高提升了 86.3%。

原文链接:https://arxiv.org/abs/2601.21343

Hosts & Guests

No transcript available for this episode.