Loading...

About this Episode

Seventy3:借助NotebookLM的能力进行论文解读,专注人工智能、大模型、机器人算法、crypto方向,让大家跟着AI一起进步。

如果你想要解读自己的论文,获得更多曝光度。请联系小助手微信:seventy3_podcast 加群。

合作邮箱:zhiwudazhanjiangshi#gmail.com

今天的主题是:

LLaDA2.1: Speeding Up Text Diffusion via Token Editing

Summary

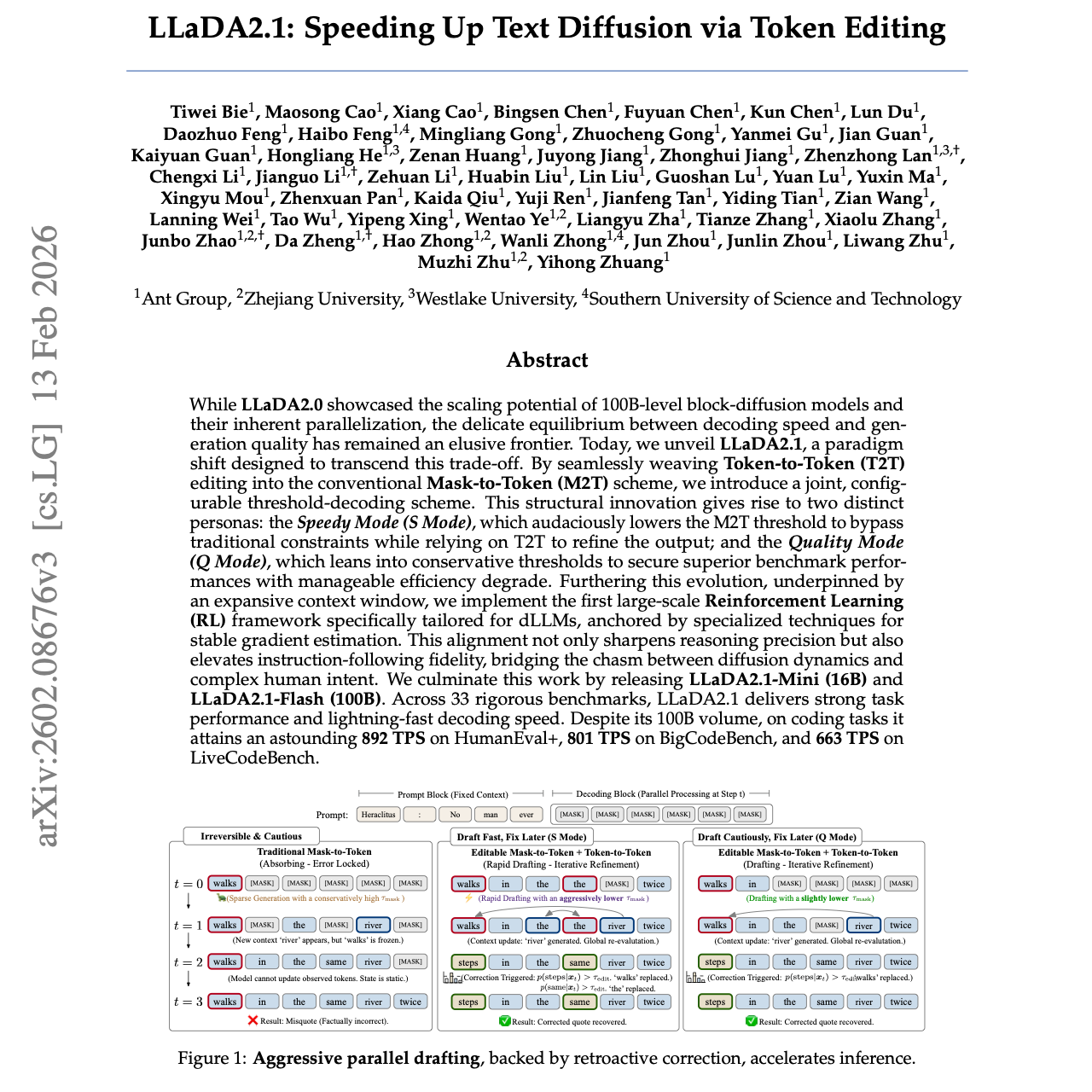

虽然 LLaDA 2.0 展示了千亿级块扩散(Block-diffusion)模型的扩展潜力及其固有的并行化优势,但在解码速度与生成质量之间寻找微妙的平衡,依然是一个难以逾越的前沿课题。今天,我们推出了 LLaDA 2.1,旨在通过范式转换超越这一权衡。

通过将 Token 到 Token(T2T)编辑无缝织入传统的掩码到 Token(M2T)方案中,我们引入了一种联合且可配置的阈值解码机制。这种结构创新催生了两种截然不同的模式:

- 速度模式(S Mode):大胆降低 M2T 阈值以突破传统约束,同时依赖 T2T 对输出进行细化;

- 质量模式(Q Mode):倾向于保守阈值,以可控的效率损耗换取卓越的基准测试表现。

为了进一步推进这一演进,在超长上下文窗口的支持下,我们实现了首个专门为扩散语言模型(dLLMs)定制的大规模强化学习(RL)框架,并辅以稳定的梯度估计专门技术。这种对齐不仅提高了推理精度,还提升了指令遵循的忠实度,弥合了扩散动力学与复杂人类意图之间的鸿沟。

我们最后发布了 LLaDA 2.1-Mini (16B) 和 LLaDA 2.1-Flash (100B)。在 33 项严苛的基准测试中,LLaDA 2.1 展现了强大的任务性能和极快的解码速度。尽管拥有千亿参数规模,它在编程任务上的表现依然令人惊叹:在 HumanEval+ 上达到 892 TPS,在 BigCodeBench 上达到 801 TPS,在 LiveCodeBench 上达到 663 TPS。

原文链接:https://arxiv.org/abs/2602.08676

Hosts & Guests

No transcript available for this episode.